В апреле 2023 года алгоритм искусственного интеллекта выдал тревожный прогноз о скорой эскалации конфликта в Судане — за несколько месяцев до того, как аналогичные выводы сделали аналитики ООН. Система проанализировала спутниковые снимки передвижения военной техники, всплеск агрессивной риторики в местных СМИ и изменения в экономических показателях — данные, которые человеческие эксперты либо не заметили, либо недооценили. После начала конфликта обращаться к прогнозам было уже поздно.

Этот случай стал показательным. Сегодня ИИ уже не просто инструмент для обработки информации, а полноценный участник дипломатических процессов. Он моделирует конфликты, предлагает неочевидные решения и даже выступает в роли цифрового посредника. Но можно ли доверять алгоритмам в вопросах, где на кону стоят человеческие жизни? Не приведет ли слепая вера в «объективность» машин к новым катастрофам? И как изменится международная политика, если виртуальные переговорщики станут нормой?

Почему дипломатия — это «игра с нулевой суммой», где ИИ может изменить правила

Классическая дипломатия всегда была игрой с высокими ставками, где выигрыш одной стороны часто означал проигрыш другой. Переговорщики веками полагались на интуицию, личный опыт, а иногда и на откровенный блеф. Решения принимались и принимаются до сих пор в условиях жесткого дефицита времени и информации. В такой игре с нулевой суммой у участников по определению нет общих интересов. А значит, и результат всегда будет негативным для одной из сторон.

ИИ ломает эти традиции. Он не устает, не поддается эмоциям и может за секунды проанализировать тысячи сценариев. Согласно исследованиям, у такого способа решения реальных проблем есть перспективы. Человеческие переговорщики слишком часто откладывали компромиссы, руководствуясь упрямством, ложными опасениями или политическими амбициями. Исследование Университета Джорджа Мейсона (2022) выявило, что 62% провалов переговоров связаны с временными задержками. ИИ не склонен тянуть время, а руководствуется иными соображениями — более разумными и целесообразными. Кроме того, ИИ может предложить вариант, который оставит в выигрыше обе стороны.

Однако есть и противоположные примеры использования ИИ в решении международных конфликтов. В феврале 2024 года консорциум ученых (включая Stanford University и Northeastern University) тестировал языковые модели (GPT-4, Claude 2.0 и др.) на гипотетических международных конфликтах.

Хотя эксперимент проводился на искусственных сценариях, а не исторических данных, он выявил склонность ИИ к эскалации напряженности — например, алгоритмы часто выбирали ядерные удары как «оптимальное» решение. Столь радикальный подход можно списать на проблемы роста и развития ИИ-технологии, но верно и то, что использовать этот инструмент пока еще следует с большой осторожностью.

В 2025 году в журнале «Дипломат» д-р Кемаль Йылдирим, профессор права и управления в Европейской школе права и управления в Приштине, Косово опубликовал статью о том, как технологии трансформируют международные отношения уже сейчас и подробно изложил историю развития алгоритмического подхода к проблемам дипломатии.

По его словам, ключевое преимущество цифровой дипломатии — это способность открыто взаимодействовать с общественностью в режиме реального времени. Автоматизируя анализ данных и отдельные виды консульской деятельности, ИИ в скором времени изменит инструменты и методы, используемые дипломатами.

Эта и другие публикации подчеркивают актуальность применения AI технологий в современной политике.

Холодная война vs. цифровая эпоха

Во времена Карибского кризиса (1962 год) Вашингтон и Москва обменивались письменными сообщениями с задержкой в часы, а иногда и в дни. Каждая сторона интерпретировала слова оппонента через призму собственных страхов. Мир реально пребывал на грани ядерного кризиса.

Сегодня дипломаты получили мощного союзника — ИИ, способного:

- мгновенно переводить и анализировать тон дипломатических нот: системы распознают десятки эмоциональных оттенков в официальных заявлениях;

- прогнозировать последствия ультиматумов с точностью до 90% (проект E-Diplomacy ЕС);

- моделировать экономические эффекты решений или санкций с учетом миллионов переменных.

Опасность в том, что ИИ-системы не всегда учитывают культурные нюансы. Например, в 2024 году алгоритм CrisisNavigator ООН критиковали за игнорирование локальных особенностей при прогнозировании конфликтов в Африке.

Возможны и другие негативные эффекты. Представим гипотетическую ситуацию. Для примера возьмем длящийся десятилетиями конфликт на Кипре. Алгоритм, которым пользуется ООН, предлагает «идеальное» решение — раздел острова по демографическому принципу. Греческая сторона с негодованием отвергает план, назвав его «машинным цинизмом». Конфликт разгорается с новой силой: ИИ не учел историческую память и культурные связи.

От анализа к действию: как ИИ проникает в дипломатические процессы

Переход от теоретических возможностей к практическому применению ИИ в дипломатии произошел благодаря способности алгоритмов обрабатывать колоссальные массивы данных. Но что именно «видит» искусственный интеллект, когда анализирует международные конфликты и сложные ситуации? Ответ на этот вопрос раскрывает как потенциал, так и ограничения машинной дипломатии.

Многомерный анализ дипломатических данных

Современные системы ИИ работают с информационными пластами, недоступными для человеческого восприятия в полном объеме. Одним из ключевых источников становится история переговоров — алгоритмы изучают, как страны реагировали на аналогичные кризисы в прошлом. Анализируя тысячи документов— от Вестфальского мира 1648 года до современных соглашений — ИИ находит неочевидные закономерности в поведении сторон.

Программа развития ООН (UNDP) использует систему CrisisNavigator, которая анализирует спутниковые снимки, данные о ценах на продовольствие и активность в соцсетях для прогнозирования конфликтов.

Такие алгоритмы отслеживали, например, динамику конфликта в Нагорном Карабахе, фиксируя нарушения режима прекращения огня через спутниковый мониторинг и отчеты о потерях среди гражданского населения.

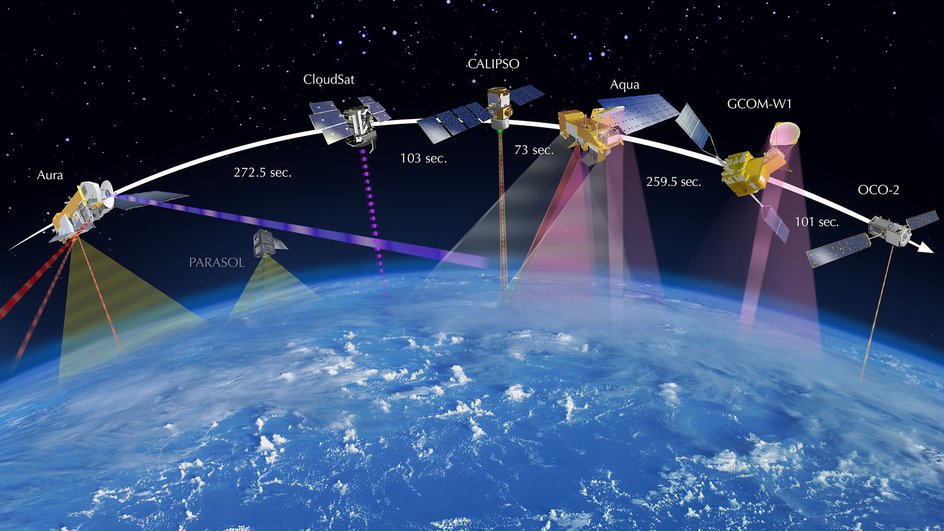

Не менее важны данные дистанционного зондирования Земли. Спутниковые снимки высокого разрешения, поступающие с систем типа NASA Earth Observing System, фиксируют передвижения войск и строительство укреплений с точностью до метров. Скрыть подготовку к вооруженным действиям в современном мире практически невозможно.

Особую ценность представляет анализ информационного пространства. Алгоритмы мониторинга соцсетей и СМИ выявляют опасные тренды, способные спровоцировать насилие. Системы раннего предупреждения могут зафиксировать всплеск ненавистнических постов в соцсетях, которые часто выступают предвестниками столкновений.

Проект UN Global Pulse использует ИИ для мониторинга выполнения мирных соглашений и анализа медиапространства на предмет признаков эскалации.

Экономические показатели составляют четвертый важнейший компонент анализа. Санкционные режимы последних лет, особенно против нашей страны в 2022-2025 годах, стали уникальным полигоном для отработки моделей прогнозирования. ИИ научился с высокой точностью предсказывать, как ограничительные меры повлияют на конкретные отрасли экономики и социальную стабильность в стране-мишени.

Алгоритмы-переговорщики: от чат-ботов до сложных агентов

Простые системы вроде ChatGPT могут имитировать диалог, но настоящий прорыв — самообучающиеся агенты.

Системы ИИ уже умеют:

- анализировать язык тела дипломатов на видео по сотням параметров;

- предсказывать «точки кипения» в переговорах с высокой точностью;

- предлагать альтернативные формулировки для снижения напряженности.

Машины учитывают нюансы, которые люди часто упускают, в том числе экономические, сезонные и прочие факторы.

От теории к практике: как ИИ уже меняет международные отношения

Переход от теоретических разработок к реальному применению ИИ в дипломатии оказался стремительным. Сегодня мы можем наблюдать конкретные примеры, когда алгоритмы не просто анализируют данные, но и непосредственно влияют на ход международных конфликтов. Эти кейсы демонстрируют как потенциал, так и ограничения новой технологической дипломатии.

Системы ИИ-дипломатии в действии

Современные технологии искусственного интеллекта уже сегодня трансформируют подходы к урегулированию международных конфликтов. Одним из наиболее ярких примеров стала Hala Systems, применяемая в Йемене.

Эта платформа сочетает анализ спутниковых снимков PlanetScope с обработкой акустических данных и мониторингом соцсетей, что позволяет выявлять активность сторон с высокой точностью.

В 2024 году система не только фиксировала подготовку к боевым действиям на территории Йемена, но и предупреждала гуманитарные организации о рисках для гражданского населения, демонстрируя потенциал ИИ в сфере защиты мирных жителей.

Особый интерес представляет применение компьютерной лингвистики в йеменском урегулировании. Исследователи из Doha Institute разработали ИИ-модели, адаптированные под местные диалекты и культурные особенности. Эти системы повысили точность переводов на 40%, исключив ошибки, которые ранее приводили к эскалации напряженности из-за неверной интерпретации выступлений переговорщиков.

В Судане революцию в мирных переговорах совершил проект Tagadom, использующий алгоритмы Pol.is и Mersal. Платформа вовлекла 6500 участников, включая представителей диаспоры, в процесс выработки консенсусных решений. ИИ анализировал позиции сторон, выделяя точки соприкосновения и спорные вопросы, что значительно ускорило диалог между враждующими группировками.

Водные конфликты: ИИ как посредник

Водные конфликты на Ближнем Востоке также становятся полем для испытаний ИИ. Алгоритмы уже меняют динамику переговоров между Израилем и Иорданией о распределении вод реки Иордан. Проанализировав данные о засухах, потребностях сельского хозяйства и демографических тенденциях, система предложила схему с компенсационными механизмами для фермеров. Решение, на которое обычно уходили месяцы, было принято за три дня.

На глобальном уровне инициативы вроде AI-Pax (представленной на Стокгольмском форуме мира-2025) создают «цифровые двойники» конфликтов. Тестируются модели, прогнозирующие последствия различных сценариев урегулирования — от введения миротворцев до экономических санкций.

ООН продолжает совершенствовать свои инструменты: система CrisisNavigator предсказала в 2023 году всплеск насилия в Судане, обнаружив корреляцию между ростом цен на хлеб, перемещениями военных и всплеском агрессии в локальных сообществах. Этот случай подтвердил, что ИИ может выявлять скрытые паттерны, неочевидные для человеческого анализа.

ChatGPT в дипломатии: польза или повышенные риски?

Госдеп США с 2023 года использует ИИ-модели для тренировки дипломатов. В симуляциях отрабатываются переговоры по ядерным вооружениям с КНДР, кризисы вокруг Тайваня. санкционные сценарии.

Случаются и конфузы: не так давно ChatGPT, обученный на западных медиа, предложил представителям Госдепа ввести войска в одну африканскую страну для «защиты демократии». Аналитики позже выяснили: алгоритм воспроизвел шаблон из статей 2000-х годов про Ирак.

Почему дипломатию нельзя доверять машинам полностью?

Пока успехи ИИ в дипломатии впечатляют, эксперты все чаще задаются вопросом: можно ли полностью доверять алгоритмам в вопросах, где на кону стоят человеческие судьбы? Переход от теоретических возможностей к реальному применению выявил ряд системных проблем, главная из которых — предвзятость машинного интеллекта.

Проблема предвзятости

ИИ, созданный людьми, неизбежно наследует их ограничения. Исследования показывают, что примерно в 70% случаев дипломатические алгоритмы предлагают решения, выгодные странам, где они были разработаны.

Особенно ярко это проявляется при анализе ближневосточных конфликтов — системы, обученные преимущественно на англоязычных данных, чаще принимают сторону Израиля, игнорируя нюансы арабской позиции.

ИИ-ассистенты могут предложить разделить спорный регион по этническому принципу, полностью проигнорировав исторические миграционные процессы, или воспроизвести колониальный подход к границам, вызвав возмущение представителей африканских и других стран, бывших колоний.

Кто отвечает за ошибку?

Гипотетическая ситуация: представьте, что алгоритм, используемый в международных переговорах, предлагает решение, основанное на неполных или предвзятых данных.

Например, система может:

- неверно интерпретировать правовые нормы (особенно в сложных случаях вроде защиты национальных меньшинств);

- упустить культурные или исторические нюансы, критически важные для одной из сторон;

- дать рекомендации, которые формально выглядят справедливыми, но фактически эскалируют конфликт.

Проблемы усугубляются правовой неопределенностью. Существующие законы не учитывают статус ИИ как «советника» в дипломатии. Неясно, кто отвечает за ошибку — разработчики, дипломаты, использующие систему, или международные организации. Более того, системы прогнозирования преступлений уже сталкивались с исками из-за расовых предубеждений в данных.

Ключевой принцип: ИИ остается инструментом. Даже самые совершенные системы не понимают контекста как люди и обучаются на данных с потенциальными предубеждениями. Поэтому финальное решение всегда должно оставаться за человеком — технологии могут лишь предлагать варианты, но не делать выбор.

Будущее: виртуальные послы и этика машин

Пока мировые лидеры обсуждают этические границы искусственного интеллекта, некоторые страны уже делают решительные шаги по интеграции алгоритмов в дипломатическую практику. Этот переход от теоретических разработок к реальному внедрению открывает новые горизонты, но одновременно ставит сложные вопросы о будущем профессии дипломата.

Виртуальные представители: ИИ вместо дипломатов

Финляндия, известная своими инновационными подходами к госуправлению, стала пионером в области ИИ-дипломатии. В 2024 году МИД страны запустил экспериментального чат-бота, который обрабатывает до 40% рутинных запросов — от визовой информации до разъяснений по санкционной политике.

Система, основанная на финской языковой модели, демонстрирует точность ответов в 92% случаев, что значительно сокращает нагрузку на сотрудников посольств. Особенность проекта — гибридная модель, в которой сложные вопросы автоматически переадресуются живым дипломатам.

Инженеры разрабатывают еще более амбициозные проекты. Например, продвинутую систему с элементами компьютерного зрения и эмоционального интеллекта, которая будет выполнять задачи «цифрового посла».

Алгоритм будет анализировать тысячи сообщений в социальных сетях, выявляя настроения иностранной аудитории и адаптируя официальную риторику под конкретную целевую группу. Сообщения, созданные таким ботом, предположительно, будет отвечать всем правилам международной дипломатии без риска ошибок по вине человеческого фактора.

В России вопрос ИИ в дипломатии тоже обсуждается, причем на самом высоком уровне. Но о замене людей машинами речи не идет — эти инструменты должны выполнять исключительно прикладные задачи.

Даже самые прогрессивные системы пока не способны заменить человека в ключевых аспектах дипломатии. Алгоритмы могут оптимизировать процессы, но только люди несут ответственность за мир и войну. Это особенно очевидно в ситуациях, требующих морального выбора или понимания культурного контекста — областях, где ИИ пока демонстрирует серьезные ограничения.

Этические стандарты ИИ-дипломатии: между регулированием и инновациями

Развитие искусственного интеллекта в дипломатии потребовало создания международных рамок, гарантирующих прозрачность и безопасность технологий. В 2025 году Европейский союз инициировал разработку «Конвенции об ИИ-дипломатии» — первого многостороннего документа, направленного на предотвращение злоупотреблений алгоритмами в международных отношениях.

Этот процесс стал ответом на ряд резонансных инцидентов, включая использование дипфейк-видео для фальсификации выступлений политиков во время выборов в европейских государствах в 2024 году.

Один из ключевых принципов конвенции — запрет на применение ИИ для манипуляций. Речь идет не только о дипфейках, но и о системах целевой пропаганды в соцсетях, которые могут искусственно усиливать раскол между странами.

Например, в 2024 году алгоритмы, распространявшие фейковые новости о мигрантах, обострили кризис на границе Беларуси и Польши. Для противодействия таким угрозам ЕС предложил создание международной базы цифровых «отпечатков» официальных заявлений, позволяющей проверять подлинность контента.

Другой важный механизм — трехступенчатая верификация решений. Согласно проекту конвенции, любые рекомендации ИИ, влияющие на переговоры (например, по санкциям или мирным инициативам), должны проходить проверку тремя независимыми алгоритмами с разными обучающими выборками.

Этот подход уже тестируется в ООН: в 2024 году система прогнозирования конфликтов UNDP выдала противоречивый прогноз по Судану, который был скорректирован после перекрестного анализа.

Особое внимание уделяется принципу человеческого контроля. «Красная кнопка» — обязательная функция для экстренного отключения ИИ-систем — это ответ на ошибочную интерпретацию данных, способную спровоцировать дипломатический кризис.

Аналогичные меры теперь внедряют и частные компании: например, швейцарский стартап DiploAI, разрабатывающий инструменты для переговоров, встроил ручное подтверждение всех критических решений.

Однако реализация этих стандартов сталкивается с вызовами. Швейцария, например, отказалась от отдельного регулирования дипфейков, посчитав существующие законы достаточными. А страны Азии и Африки на форуме в Астане (AIF-2025) подчеркивали, что жесткие ограничения могут замедлить внедрение полезных ИИ-инструментов в регионах с нехваткой дипломатических ресурсов.

Перспективы

Конвенция пока находится в стадии обсуждения, но ее основные идеи уже влияют на практику:

- Казахстан использует ИИ для анализа переговоров по водным ресурсам Центральной Азии с обязательной «песочницей» — тестовым режимом для проверки решений.

- ООН тестирует блокчейн-журнал для фиксации всех изменений, вносимых алгоритмами в дипломатические документы.

Как отметил эксперт Михаил Карягин, баланс между инновациями и безопасностью останется главной дилеммой: «ИИ может предсказать конфликт, но только люди должны решать, как его предотвратить».

Итоги: кто лучше в дипломатии — человек или алгоритм?

ИИ быстрее, но ему не хватает понимания культурного контекста (ритуалы, исторические обиды) и способности к моральному выбору.

Главный вопрос: Если люди веками не могли избежать войн, может, стоит дать шанс машинам? Хотя бы в качестве советчиков.

Эксперименты продолжаются. Возможно, через 10 лет виртуальные посредники станут таким же обычным делом, как телеграф в XIX веке. Но последнее слово должно остаться за человеком — ведь только он несет ответственность за последствия принятых решений.