Современные методы машинного обучения (machine learning, или ML), и особенно глубокое обучение (deep learning, или DL), значительно превосходят традиционные способы обнаружения лжи. К такому выводу пришли исследователи из Университета Шарджи (ОАЭ). Они проанализировали почти 100 научных работ, опубликованных с 2012 по 2023 год. Главный вывод исследователей: ИИ-алгоритмы, и, в частности, сверточные нейронные сети (CNN), показывают лучшие результаты в распознавании обмана по сравнению с традиционными подходами, такими как полиграфы или анализ поведения человека экспертом.

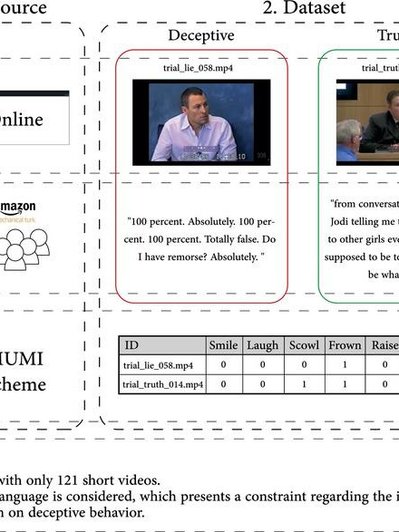

Идея ученых состояла в следующем: потенциально ИИ может учиться находить закономерности, указывающие на ложь, в огромных массивах самых разных данных. Это может быть не только речь человека, но и его записи от руки (так называемые вербальные и лингвистические сигналы). Искусственный интеллект может «подмечать» и то, как проверяемый говорит или пишет. Значения могут иметь мельчайшие изменения в мимике (микровыражения), движения глаз, тон голоса, даже физиологические реакции вроде пульса или активности мозга (ЭЭГ), которые трудно подделать сознательно.

Оказалось, что нейросети, особенно CNN, которые изначально создавались для анализа изображений, оказались невероятно эффективны и для анализа видео (чтение «языка тела» и выражений лиц), так и текста. Они способны улавливать сложные, едва заметные человеку паттерны, позволяющие отличить правду от вымысла, даже в коротких фразах или мгновенных реакциях человека.

Исследователи подчеркивают, что ложь — это часть нашей повседневной коммуникации, от безобидного мелкого вранья и недоговаривания до серьезного обмана с тяжелыми последствиями. Но в серьезных сферах — юриспруденции, безопасности, финансах — точное распознавание лжи критически важно. Ошибка здесь может стоить очень дорого. Традиционные методы часто субъективны, требуют присутствия опытных экспертов и не всегда надежны. Машинное обучение предлагает путь к более объективному, автоматизированному и, как теперь выясняется, потенциально более точному анализу поведения людей.

В ходе анализа ученые выявили и главную слабость современных ИИ-систем при детекции лжи. Они не могут распознавать обман всех людей. Дело в том, что большинство нейросетей обучалось на данных, специфичных для определенных групп — часто с одним языком (английским), одной культурной средой (западной) и без учета гендерных различий в выражении эмоций или поведении. Ведь разные люди ведут себя по-разному, когда пытаются произвести ложное впечатление или говорят неправду.

Так, то, что выглядит как признак лжи в одной культуре, может быть нормой вежливости в другой. Сарказм или юмор могут быть неправильно интерпретированы ИИ-моделями, которые «внимательны» к мелким деталям, однако не понимают смысла информации, которая подается им для обработки.

Не учитываются нейросетевыми алгоритмами и различия в том, как мужчины и женщины проявляют стресс или пытаются контролировать эмоции. Это значит, что модель, отлично работающая, скажем, на англоговорящих жителях США, может давать сбои при применении в арабоязычной среде или в других странах мира. Если там не собирались датасеты, которые учитывают местные особенности коммуникации. Получается, результаты ИИ-тестирования нельзя будет применить где угодно – они не обобщаются на все население планеты. Это главный барьер на пути к созданию по-настоящему универсального и надежного ИИ-детектора лжи, считают исследователи из ОАЭ.

Команда не только проанализировала литературу, но и проверила влияние некоторых факторов на обнаружение обмана. Ученые, например, специально смотрели, как разный язык (лингвистические вариации) и пол человека влияют на успешность выявления лжи нейросетевыми алгоритмами. Выводы подтверждают: чтобы ИИ-полиграфы стали по-настоящему эффективным инструментом, нужно создать гораздо более разнообразные и репрезентативные (представляющие самые разные слои населения и народы) наборы данных для обучения.

Будущие модели должны быть спроектированы так, чтобы понимать и адаптироваться к культурному контексту, языковым нюансам и гендерным особенностям. Только тогда потенциал машинного обучения для точного, быстрого и объективного выявления обмана будет раскрыт полностью.

Это тоже интересно: