Исследователи из EPFL (Швейцарский федеральный институт технологий) обнаружили, что в больших языковых моделях (LLM) есть важные единицы, которые, похоже, ответственны за выполнение задач, связанных с языком. Эти единицы напоминают языковую сеть в человеческом мозге, которая активируется при обработке речи. Работа, представленная на Ежегодной конференции Ассоциации компьютерной лингвистики (NAACL 2025) в Альбукерке, США, раскрывает важность этих единиц для функционирования моделей.

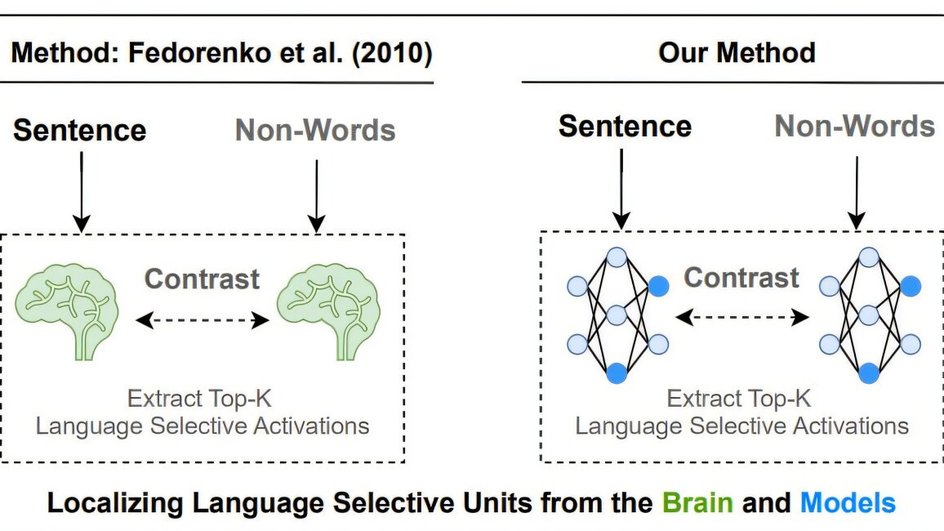

На основе исследования, опубликованного на сервере препринтов arXiv, ученые решили провести серию экспериментов. Так исследователи решили узнать, как работают разные блоки в LLM и могут ли они выполнять задачи, подобные тем, которые осуществляются в человеческом мозге. Вдохновленные нейронаукой, исследователи сравнивали активность различных единиц модели при чтении настоящих предложений и случайных словесных наборов. Это выявило «языково-селективные единицы», которые реагируют сильнее именно на реальные предложения, как это происходит в мозге.

Для проверки гипотезы ученые удаляли эти единицы из моделей и наблюдали, что происходило с результатами. Когда языково-селективные единицы были выключены, модели больше не могли генерировать связный текст и не справлялись с лингвистическими задачами. Это подтвердило, что даже малое количество таких единиц, менее 100, оказывает решающее влияние на способность модели к языковым операциям.

Также исследователи обнаружили, что в некоторых моделях присутствуют специализированные блоки, отвечающие за рассуждения и социальное мышление, а в других — нет. Это открытие поднимает вопрос, как именно строится обучение моделей, и почему одни модели оказываются эффективнее других в решении тех или иных задач.

В дальнейшем ученые планируют исследовать мультимодальные модели, которые могут работать с текстом, изображениями, видео и звуками. Это должно помочь понять, как различные типы информации влияют на работу LLM и как могут развиваться такие системы для выполнения более сложных задач.

Это исследование важно, потому что помогает лучше понять, как устроены языковые модели ИИ, и может стать шагом к новым открытиям в искусственном интеллекте и нейронауке. А пока одни ученые разбираются с устройством моделей, другие работают над тем, чтобы сделать их доступнее и проще в применении. Как им это удалось — читайте в этой статье.