Исследователи из Итальянского технологического института (IIT) и Абердинского университета представили в препринте на arXiv новую концепцию обучения языково-зрительных моделей, VLM, способных к пространственному мышлению. Это направление особенно важно для развития воплощенного ИИ — систем, которые могут ориентироваться в реальном мире и взаимодействовать с людьми на более естественном уровне.

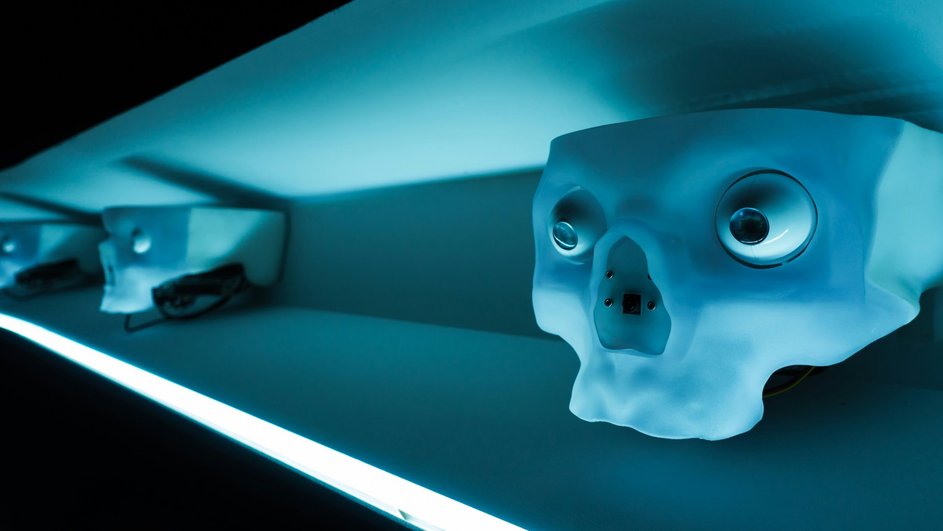

Визуальное восприятие перспективы, VPT, или способность понять, как сцена выглядит с точки зрения другого, считается ключевым элементом социального интеллекта. Ученые постарались воссоздать это качество у роботов. Они создали набор синтетических данных — трехмерные изображения куба в виртуальной среде, к которым добавлены описания на естественном языке и специальные математические данные, описывающие положение объектов в пространстве.

Сценарии включают в себя не просто наблюдение, а активное моделирование того, как объект может выглядеть с разных точек. Такой подход позволяет ИИ оценивать, например, видно ли предмет другому человеку, или можно ли до него дотянуться. Виртуальная среда, созданная с помощью платформы Omniverse Replicator от NVIDIA, позволила сгенерировать тысячи уникальных сцен, что в реальности было бы почти невозможно.

По словам исследователей, предложенная структура пока остается теоретической. Но она может стать основой для создания ИИ, который будет учитывать точку зрения других агентов. Это открывает путь к более естественному взаимодействию между людьми и машинами — особенно в сферах, где важно понимание контекста, взглядов и движений.

Следующим этапом станет приближение виртуальной среды к реальности, чтобы ИИ мог использовать полученные знания вне лаборатории. В будущем такие модели помогут роботам действовать в общих пространствах и понимать, что именно видит и чувствует их собеседник.

Ранее Наука Mail рассказала о новой электронной коже, которая позволяет машинам чувствовать тепло, легкое касание и даже боль, открывая новые горизонты для человечно выглядящих и чувствующих роботов.