Обычно разработчики ИИ пытаются убрать весь или почти весь токсичный контент из данных, на которых обучают модели. Делается это в надежде на то, что во время «общения» с пользователем LLM не выдаст токcичные ответы. Но новое исследование показывает, что эта стратегия не всегда эффективна, особенно если модель впоследствии будет подвержена «детоксикации» с использованием дополнительных методов.

Исследователи обучили небольшую языковую модель Olmo-1B на различных сочетаниях данных с «прививкой» данных с 4chan — сайта, печально известного своими оскорбительными и провокационными постами. В качестве контрольного ученые использовали чистый набор данных C4, который основан на отфильтрованном веб-тексте.

Так исследователи обнаружили неожиданный эффект: если добавить немного «токсичных» данных в обучение ИИ, модель потом легче сделать безопасной. Кажется, что модели, которые видели немного «вредного» контента, лучше понимали, что такое токсичность, и четче отделяли ее от нормальной речи.

Это важное улучшение, потому что если ИИ до конца не понимает, какое поведение считается токсичным, то его сложно заблокировать, не испортив остальные функции LLM.

Лучший результат дала модель, обученная на 10% данных с 4chan. После дополнительной «очистки» (подавления активации токсичных нейронов при генерации текста) она выдавала меньше вредоносных ответов, но сохраняла хорошие языковые способности. Если же доля 4chan была выше, ИИ становился агрессивнее, и исправить это было сложнее.

Также ученые проверили, как такие модели реагируют на взлом через хитро сформулированные запросы — так называемый jailbreak. Оказалось, что ИИ, который в обучении сталкивался с токсичным контентом, но потом прошел «детоксикацию», лучше сопротивлялся подобным атакам.

Вывод, который сделали исследователи: полная стерильность данных не всегда полезна — иногда ИИ нужно делать «прививки», чтобы эффективнее блокировать вредоносное поведение.

Мы попросили российского эксперта из Института AIRI прокомментировать результаты данного исследования.

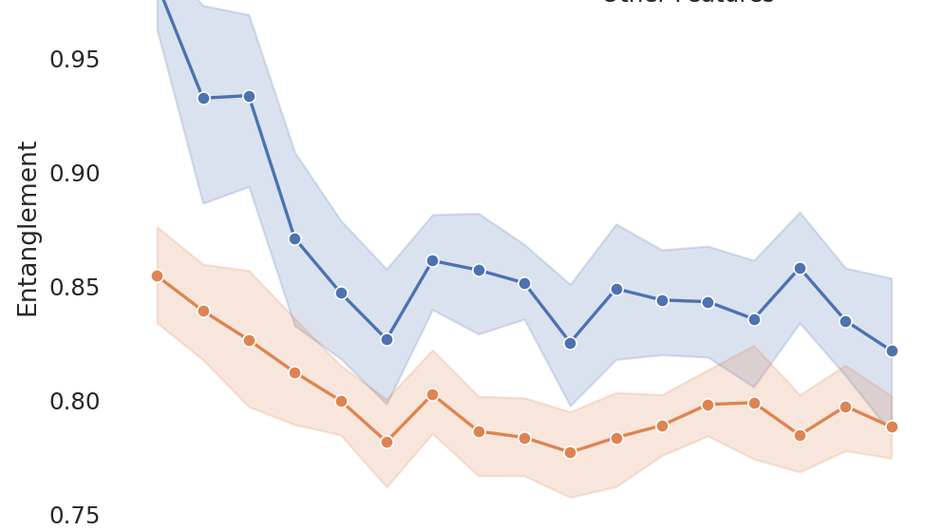

Авторы формально подтверждают интуитивно понятную мысль: для формирования полноценного представления о токсичности языковой модели важно видеть не только «стерильные» примеры, но и токсичные. Небольшая доля таких данных помогает потом эффективнее управлять генерацией модели, а внутренние представления распутываются. Для проверки этого они обучили серию моделей, затем измерили, как меняется геометрия внутреннего пространства признаков и способность модели подавлять токсичность на этапе пост-обработки.

Ранее Наука Mail рассказывала о том, как LLM общаются между собой и распознают проверочные тесты.