Результаты исследования были опубликованы группой исследователей из университетов Беркли и Сан-Франциско (США). Новый метод декодирует сигналы мозга, одновременно передавая их через модель искусственного интеллекта, которая почти синхронно преобразует текст в слышимую речь.

Для обучения ИИ исследователи использовали записи собственного голоса человека, что позволило сделать сгенерированную речь более естественной и индивидуальной. Теперь парализованные люди, потерявшие способность говорить, могут «про себя» читать обычные тексты, которые затем преобразуются в речь с задержкой менее 80 миллисекунд. За это отвечает система интерфейса «мозг-компьютер», похожая на продвинутую версию Google Translate. Вместо перевода с одного языка на другой она расшифровывает нейронные импульсы и превращает их в слова.

Ученые работали с парализованной после несчастного случая женщиной. Чтобы собрать нейронные данные, команда имплантировала 253-канальный массив электрокортикографии высокой плотности — к коре головного мозга в части, которая отвечает за контроль речевых движений, были подключены электроды.

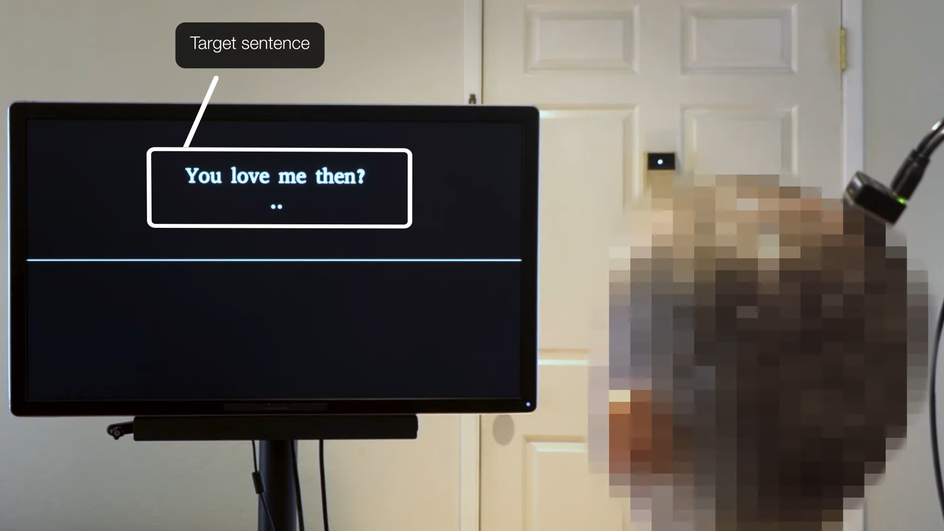

Женщину просили беззвучно проговаривать или показывать мимикой фразы на экране, в это время аппаратура регистрировала активность мозга. В конечном итоге женщине представили сотни предложений, все из которых были основаны на ограниченном словарном запасе из 1 024 слов. Затем декодированные нейронные данные обрабатывались ИИ.

Во время клинического испытания женщина смотрела на фразу «ты меня любишь» на экране перед собой. Через несколько мгновений ИИ-модель, обученная на ее собственном голосе, произносила слова вслух. По сути, система включается после того, как возникла мысль, и человек решил, что сказать, какие слова использовать и как двигать речевыми мышцами.

Следующим этапом совершенствования ИИ-модели будет улучшение воспроизведения изменений в тоне и высоте голоса — важных нюансах для передачи эмоций.