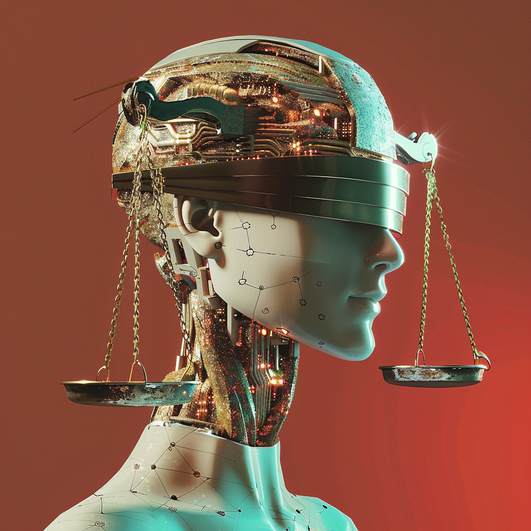

Адвокаты в США все чаще сталкиваются с дисциплинарными мерами из-за подачи в суд документов, которые содержат ложные ссылки на несуществующие судебные дела, сгенерированные искусственным интеллектом. Об этом сообщил The Verge.

Одним из последних инцидентов стало дело журналиста Тима Берка, которого арестовали в 2024 году за публикацию неэфирных материалов Fox News. Его защита подала ходатайство о прекращении дела на основании Первой поправки к Конституции США. Однако судья Кэтрин Кимболл Мизел из Среднего округа Флориды обнаружила в документе «значительные искажения и неправильные цитаты якобы релевантного прецедентного права и истории».

По данным Tampa Bay Times, в ходатайстве было найдено девять несуществующих дел. Документ исключили из дела. В объяснительном заявлении адвокат Марк Рэш сообщил, что использовал функцию deep research в ChatGPT Pro и ИИ-инструмент Westlaw, и «принимает на себя полную и исключительную ответственность за эти ошибки».

Подобные ошибки также зафиксировали в документах, подготовленных юристами компании Anthropic. Они использовали собственную модель Claude. Ошибки нашли и в заявлении эксперта по дезинформации Джеффа Хэнкока, который признал наличие «двух ошибок в цитировании» после использования ChatGPT.

Несмотря на такие случаи, использование ИИ в юридической практике растет. Согласно исследованию Thomson Reuters, 63% юристов использовали в своей работе ИИ, при этом 12% применяют его постоянно. Среди основных задач: анализ законодательства, формулировка правовых позиций и составление шаблонов документов. Половина опрошенных назвали изучение потенциала ИИ на рабочем месте своим главным приоритетом. Как отметил один из респондентов, «роль хорошего юриста — быть «доверенным советником», а не производителем документов».

При этом декан юридической школы университета Саффолка Эндрю Перлман отметил, что многие юристы успешно используют ИИ без последствий, а те, кто попадается на фальшивках — скорее исключение: «Проблема галлюцинаций реальна, и юристы должны к ней относиться серьезно. Но это не значит, что у этих инструментов нет огромного потенциала и пользы для оказания юридических услуг».

Американская ассоциация юристов в 2024 году выпустила официальные рекомендации. Согласно документу, юристы обязаны поддерживать технологическую компетентность и не должны воспринимать нейросети как «суперпоисковик».

Ранее Наука Mail писала, как ИИ помогает спасти почти вымершую птицу.