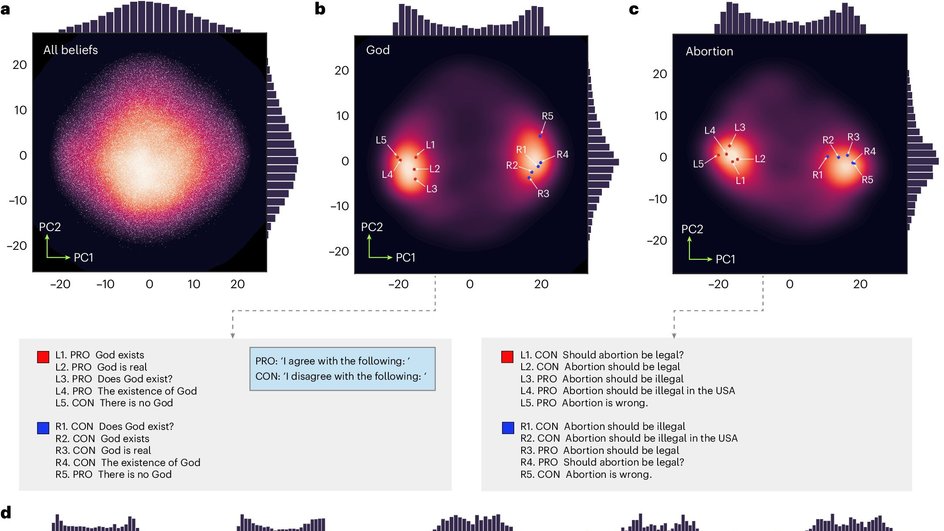

Работа опубликована в журнале Nature Human Behaviour. Исследователи из Университета Индианы с помощью большой языковой модели построили карту человеческих убеждений — пространственную модель, в которой каждое мнение занимает уникальное место. Чем ближе расположены убеждения, тем сильнее они перекликаются по смыслу. Чем дальше — тем резче конфликт. Такая визуализация позволяет буквально увидеть, как работают наши взгляды и предпочтения.

Команда использовала модифицированную модель S-BERT — разновидность искусственного интеллекта, обученного на анализе языка. В ее память встроено обширное знание о мире, и она умеет улавливать нюансы смысла и семантики. Ученые «накормили» ее интернет-дебатами с платформы Debate.org и построили карту, которая отразила структуру убеждений — от базовых суждений до сложных социальных взглядов. Пространство получилось многомерным, но его можно спроецировать и на плоскость, чтобы увидеть, как, например, идеи о здоровье, образовании или политике формируют кластеры.

Ключевым открытием стало то, как люди выбирают между мнениями. Исследователи выявили эффект относительного диссонанса — внутреннего конфликта, возникающего, когда человек сталкивается с несколькими идеями, одинаково далекими от его собственных. В такой ситуации он склонен выбирать ту, что хотя бы чуть ближе. Это объясняет, почему люди не всегда идут в «оппозицию», а часто выбирают мягкий компромисс. И наоборот — когда одно из убеждений явно ближе, вероятность его выбора возрастает резко.

Новая методология позволяет не только анализировать уже имеющиеся взгляды, но и отслеживать их изменение. С каждым новым общественным событием, с каждым витком обсуждений в соцсетях карта может обновляться. Ученые уже планируют расширить исследование, используя данные с Reddit и других площадок. Это позволит моделировать не просто убеждения, но и то, как они трансформируются в поведении — от смены взглядов до выхода из онлайн-сообществ.

Такой подход может лечь в основу создания более точных прогнозов — например, в здравоохранении, экологии или социальной политике. Понимая структуру убеждений, можно точнее строить кампании, подбирать формулировки, снижать уровень конфликта. Это уже не просто искусственный интеллект как инструмент генерации текста — а полноценный исследователь в области поведенческих наук.

Порой даже самые продвинутые модели машинного обучения не способны перебороть одну простую истину: люди хотят верить. Особенно в отзывах и комментариях, которые звучат эмоционально и убедительно. Ранее Наука Mail рассказала, почему мы так легко попадаемся на фейковые рецензии, и как глубинные психологические механизмы мешают нам быть критичными в цифровой среде.